Die Verbindung von Mensch und Maschine wird immer enger. Wir beginnen auf eine Weise mit der Technik zu interagieren, die es vorher so nicht gab. Das bringt neue Chancen, aber auch Risiken mit sich und wirft nicht selten ethische Fragen auf.

Längst lassen sich Prothesen und Roboterarme per Gedankenkraft steuern und sogar Flugzeuge und Hubschrauber steuern ihren Kurs allein durch die Gedanken ihres Piloten.

Wenn Computer Gedanken lesen

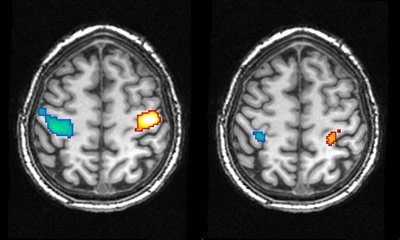

Umgekehrt beginnen lernfähige Algorithmen, das Muster unseres Denkens immer weiter zu entschlüsseln. In ersten Versuchen gelang es bereits, Wörter und Sätze oder Trauminhalte allein aus den Gedanken der Probanden herauszulesen. 2014 übertrugen Forscher digital kodierte Hirnströme von einem Menschen zum anderen und vermittelten so erkennbare Botschaften.

Noch weiter gehen Neurotechnologien, die unser Verhalten oder bestimmte Hirnfunktionen gezielt beeinflussen, beispielsweise bei Parkinson oder schweren Depressionen. In ersten Experimenten erproben Forscher bereits Methoden, mit denen auch unser Fühlen, Denken und Träumen gezielt manipuliert wird. An der Kombination von auslesenden und stimulierenden Systemen („closed loop“) wird ebenfalls schon gearbeitet.

Vom Gehirn zum Digitalsignal

All diesen Experimenten und Neurotechnologien liegt eine Schnittstelle von Mensch und Maschine zugrunde. Elektroden lesen die Hirnströme aus und leiten diese an einen Computer weiter. Soll mit diesen Signalen eine Prothese oder ein Roboter gesteuert werden, dann werden Elektroden meist in den motorischen Cortex, den für Bewegungen zuständigen Teil des Gehirns, implantiert oder diesem aufgelegt.

Auf dem angeschlossenen Rechner läuft eine Software, die diese Signale verarbeitet und lernt, Muster wiederzuerkennen und zu interpretieren. Die für diese Neurotechnologien eingesetzten Programme sollen beispielsweise Neuroprothesen in dem Sinne „intelligent“ machen, dass sie auf die Umwelt reagieren und beispielsweise keine Becher umstoßen. Sie können sogar lernen, welche Greifbewegung der Patient beabsichtigt, um diese dann selbstständig auszuführen. Die Software übersetzt die Hirnströme dann in digitale Befehle, mit denen die Prothese gesteuert wird.

PD Dr. Oliver Müller für bpb.de / CC-by-sa 3.0

Stand: 16.10.2015