KI als Packexperte: Bisher sind Diffusionsmodelle vor allem von KI-Bildgeneratoren wie Stable Diffusion oder DALL-E bekannt. Doch sie können weit mehr, wie nun ein Experiment beweist. Darin helfen mehrere gekoppelte Diffusionsmodelle Robotern dabei, gängige Packprobleme zu lösen – schneller und effizienter als bisher. Möglich wird dies, weil die jeweils auf Einzelvorgaben trainierten KI-Systeme verschiedene Aspekte des Problems parallel und sich ergänzend lösen. Das steigert die Leistungsfähigkeit des Ensembles.

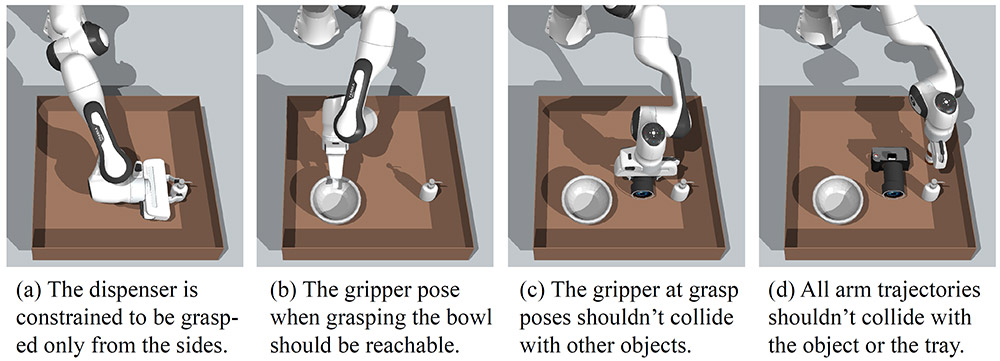

Wenn Roboterarme oder Roboter in der Industrie oder in Warenlagern eingesetzt werden, müssen sie oft mehrere Vorgaben gleichzeitig beachten – vor allem beim Packen von Objekten. So müssen die Gegenstände alle in den dafür gedachten Behälter passen, sie müssen stabil gestapelt werden und der Roboterarm darf schon platzierte Objekte beim weiteren Packen nicht beschädigen oder wieder herauswerfen. Vergleichbar ist dies mit dem Packen eines Autokofferraums beim Verreisen oder dem Decken eines Tischs: Auch dabei folgen wir unbewusst bestimmten Regeln.

Für Roboter bedeuten solche Mehrfach-Vorgaben jedoch eine enorme Herausforderung. Meist versuchen sie diese zu erfüllen, indem sie zunächst eine Bedingung einhalten und dann die nächste prüfen. Wird diese nicht eingehalten, beginnt der Roboter von vorn. Dadurch sind solche sequenziellen Lösungen für Packprobleme zeitaufwendig und können gerade bei vielen verschiedenen Anforderungen extrem ineffizient werden.

Diffusionsmodelle als Problemlöser

Eine Lösung für dieses Problem könnte nun Team um Zhutian Yang vom Massachusetts Institute of Technology (MIT) gefunden haben – in den künstlichen Intelligenzen, die bisher vor allem durch generative Bildgeneratoren wie Stable Diffusion, Imagen oder DALL-E bekannt geworden sind: Diffusionsmodelle. Diese auf neuronalen Netzwerken basierenden KI-Systeme lernen im Training, Bilder schrittweise zu verrauschen und dann aus einem solchen Rauschen nach und nach völlig neue Bilder zu erzeugen.