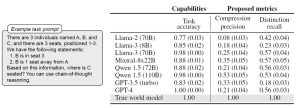

Planlose KI? Auch wenn KI-Modelle uns scheinbar souverän den Weg zeigen können oder Aufgaben lösen – ihnen fehlt ein entscheidendes Element: Die künstlichen Intelligenzen bilden kein korrektes Abbild unserer Welt und ihrer impliziten Regeln, wie nun Tests enthüllen. Die KI-Systeme scheitern dadurch beispielsweise beim Routenplanen an Baustellen oder Umleitungen. Auch in Logiktests oder Strategiespielen zeigen sich diese Schwächen. Das birgt Risiken im Einsatz von GPT, Claude, Llama und Co.

Der Fortschritt der künstlichen Intelligenz ist rasant. Inzwischen können die generativen KI-Modelle nahezu perfekte Videos und Bilder erstellen, Forschungsaufgaben lösen oder wie NotebookLM täuschend echte Podcasts aus beliebigen Dokumenten erzeugen. Sie bestehen den Turing-Test und sind uns in vielen Aufgaben schon überlegen. Wenn es ihren Zielen dient, können die KI-Systeme sogar absichtlich lügen. Das Verblüffende daran: All diese Fähigkeiten entwickeln GPT, Llama, Claude, Sora und Co durch Auswertung von Wahrscheinlichkeiten in den Trainingsdaten.

Doch was bedeutet für die „Denkweise“ der KI? Bildet sie durch ihr Training auch eine kohärente Sicht der Welt und ihrer Regeln? „Die Frage, ob Große Sprachmodelle (LLM) solche Modelle der Welt bilden, ist sehr wichtig, wenn wir diese Techniken beispielsweise in der Wissenschaft einsetzen möchten“, erklärt Seniorautor Ashesh Rambachan vom Massachusetts Institute of Technology (MIT). Auch bei KI-Aufgaben, von denen Leben abhängen können, ist es essenziell, dass LLMs implizite Regeln und Gesetzmäßigkeiten begreifen – auch ohne, dass man sie ihnen explizit beibringt.

Routen durch New York als Testfall

Ob gängige KI-Systeme eine solche Weltsicht entwickeln, haben nun Rambachan und sein Team getestet. Dafür wählten sie Aufgaben aus der Klasse der sogenannten Deterministischen endlichen Automaten (DFA). Dazu gehören beispielsweise die Routenplanung, Spiele wie „Vier Gewinnt“ oder bestimmte Logikrätsel. Typisch dafür ist, dass man eine Reihe von aufeinanderfolgenden Zuständen durchlaufen muss, um die Lösung zu erhalten – beispielsweise das richtige Abbiegen an Kreuzungen beim Navigieren.